딥러닝 기반 비디오 스트리밍 기술, 열악한 인터넷 환경에서도 고품질 유지

여현호, 정영목, 김재홍 학생이 주도한 이번 연구 결과는 격년으로 개최되는 컴퓨터 시스템 분야의 유명 학술회의인 ‘유즈닉스 OSDI(USENIX OSDI)’에서 10월 10일 발표됐고 현재 국제 특허 출원을 완료했다.

이 기술은 유튜브, 넷플릭스 등에서 비디오를 사용자에게 전송할 때 사용하는 적응형 스트리밍(HTTP adaptive streaming) 비디오 전송기술과 딥러닝 기술인 심층 콘볼루션 신경망(CNN) 기반의 초해상화를 접목한 새로운 방식이다.

이는 열악한 인터넷 환경에서도 고품질, 고화질(HD)의 비디오 시청이 가능할 뿐 아니라 4K, AV/VR 등을 시청할 수 있는 새로운 기반 기술이 될 것으로 기대된다.

기존의 적응형 스트리밍은 시시각각 변화하는 인터넷 대역폭에 맞춰 스트리밍 중인 비디오 화질을 실시간으로 조절한다. 이를 위해 다양한 알고리즘이 연구되고 있으나 네트워크 환경이 좋지 않을 때는 어느 알고리즘이라도 고화질의 비디오를 감상할 수 없다는 한계가 있다.

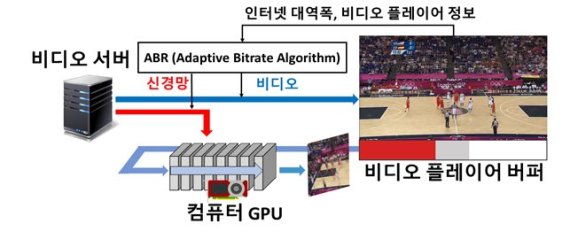

연구팀은 적응형 스트리밍에 초해상화를 접목해 인터넷 대역폭에 의존하는 기존 적응형 스트리밍의 한계를 극복했다. 기존 기술은 비디오를 시청 시 긴 영상을 짧은 시간의 여러 비디오 조각으로 나눠 다운받는다. 이를 위해 비디오를 제공하는 서버에서는 비디오를 미리 일정 시간 길이로 나눠 준비해놓는 방식이다.

연구팀이 새롭게 개발한 시스템은 추가로 신경망 조각을 비디오 조각과 같이 다운받게 했다. 이를 위해 비디오 서버에서는 각 비디오에 대해 학습이 된 신경망을 제공하며 또 사용자 컴퓨터의 사양을 고려해 다양한 크기의 신경망을 제공한다.

제일 큰 신경망의 크기는 총 2메가바이트(MB)이며 비디오에 비해 상당히 작은 크기이다. 신경망을 사용자 비디오 플레이어에서 다운받을 때는 여러 개의 조각으로 나눠 다운받으며 신경망의 일부만 다운받아도 조금 떨어지는 성능의 초해상화 기술을 이용할 수 있도록 설계했다.

사용자의 컴퓨터에서는 동영상 시청과 함께 병렬적으로 심층 콘볼루션 신경망(CNN) 기반의 초해상화 기술을 사용해 비디오 플레이어 버퍼에 저장된 저화질 비디오를 고화질로 바꾸게 된다. 모든 과정은 실시간으로 이뤄지며 이를 통해 사용자들이 고화질의 비디오를 시청할 수 있다.

연구팀이 개발한 시스템을 이용하면 최대 26.9%의 적은 인터넷 대역폭으로도 최신 적응형 스트리밍과 같은 체감 품질(QoE, Quality of Experience)을 제공할 수 있다. 또 같은 인터넷 대역폭이 주어진 경우에는 최신 적응형 스트리밍보다 평균 40% 높은 체감 품질을 제공할 수 있다.

이 시스템은 딥러닝 방식을 이용해 기존의 비디오 압축 방식보다 더 많은 압축을 이뤄낸 것으로 볼 수 있다. 연구팀의 기술은 콘볼루션 신경망 기반의 초해상화를 인터넷 비디오에 적용한 차세대 인터넷 비디오 시스템으로 권위 잇는 학회로부터 효용성을 인정받았다.

한 교수는 “지금은 데스크톱에서만 구현했지만 향후 모바일 기기에서도 작동하도록 발전시킬 예정”이라며 “이 기술은 현재 유튜브, 넷플릭스 등 스트리밍 기업에서 사용하는 비디오 전송 시스템에 적용한 것으로 실용성에 큰 의의가 있다”고 말했다.

이번 연구는 과학기술정보통신부 정보통신기술진흥센터(IITP) 방송통신연구개발 사업의 지원을 받아 수행됐다.

seokjang@fnnews.com 조석장 기자

※ 저작권자 ⓒ 파이낸셜뉴스, 무단전재-재배포 금지