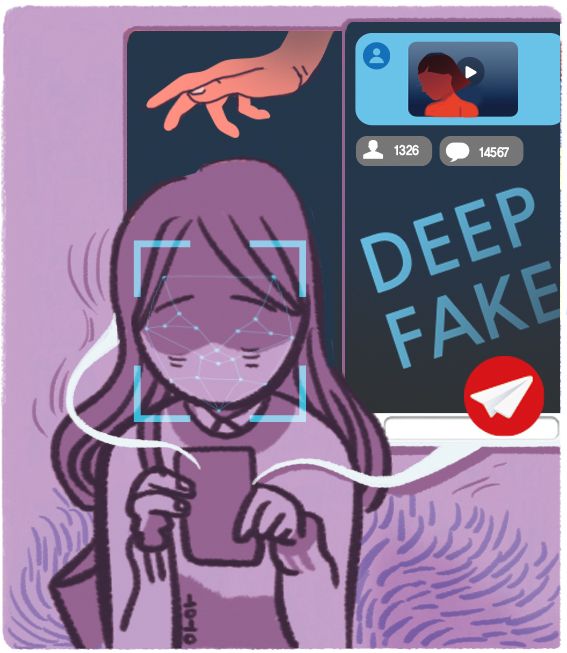

SNS에 올린 영상이 범죄도구로 악용

"피해예방 위해 경찰에 반드시 신고해야"

[파이낸셜뉴스] #외국인 A씨는 지난 10월 딸이 감금된 채 울면서 살려달라고 외치는 영상을 전송받았다. 범인은 "당신 딸을 납치했다. 딸을 살리고 싶으면 합의금을 보내라"고 A씨를 협박했다. A씨는 한국을 여행 중이던 딸의 위치를 찾기 위해 영사관에 연락해 안전을 확인했다. 알고 보니 전송 받은 영상은 딥페이크(인공지능 기술로 만든 허위 영상물)였다는 사실을 알게 됐다.

최근 딥페이크로 자녀의 얼굴을 합성한 가짜 영상을 제작한 뒤 금전을 요구하며 협박하는 전화금융사기(보이스피싱)가 발생해 수사당국이 주의를 당부했다.

경찰청 국가수사본부는 6일 "외국인을 대상으로 한 사기범행이 확인돼 국내에서도 유사한 사건이 발생할 가능성이 있다"며 이같이 밝혔다.

영사관을 통해 납치 신고를 접수받은 경찰은 피해가 발생하지 않았다는 사실을 확인했다. 하지만 이같은 보이스피싱 피해를 예방하기 위해서는 관련 기술이 범죄에 악용될 수 있다는 사실을 반드시 숙지해야 한다고 강조했다.

이번 사건에서는 딥페이크와 함께 '딥보이스'가 활용됐다. AI가 특정 인물의 목소리를 학습해 가짜 음성을 생성하는 기술이다. 범인들은 부모·자식 등 가족관계의 특수성을 이용, 부모가 판단력을 잃게 만든 뒤 송금을 요구했다.

사회관계망서비스(SNS) 등에 공개된 사진·영상 등 개인정보가 범죄조직의 표적이 될 수 있어 주의가 필요하다. 딥페이크, 딥보이스 모두 실제 인물의 얼굴과 목소리를 학습해야 한다.

'가족이나 지인을 납치했다'는 협박 전화를 받으면 반드시 112에 신고해야 한다고 경찰은 당부했다. 경찰은 납치 신고를 접수하면 당사자 위치 파악 등 가장 먼저 초동조치에 나선다. 이를 통해 요구조자의 안전을 확보하고 금전 피해를 막을 수 있다. 반면 범죄조직은 피해자들이 두려움과 걱정 때문에 신고를 주저한다는 점을 악용한다. 전화를 끊지 말라는 협박 때문에 경찰에 신고하기 곤란하면 주변 사람에게 신고를 부탁하거나 문자메시지로 112에 신고할 수 있다.

올 들어 지난 9월까지 딥페이크 등을 이용한 납치빙자형 보이스피싱은 174건 발생했다. 경찰은 AI를 악용한 피싱범죄 예방 홍보 콘텐츠를 만들어 국내는 물론 해외 주재관, 한인회 등을 통해 전파할 예정이다.

경찰 관계자는 "딥페이크 기술이 고도화돼 전문가들조차 육안으로 진위를 판단하기 어려운 만큼 SNS 등에 불특정 다수가 볼 수 있도록 게시물을 올리는 것을 지양해야 한다"고 강조했다. 이어 "납치 전화가 보이스피싱일 가능성을 항상 염두에 두고 무조건 경찰에 신고해야 한다"고 덧붙였다.

unsaid@fnnews.com 강명연 기자

※ 저작권자 ⓒ 파이낸셜뉴스, 무단전재-재배포 금지